Con técnica informática, criminales manipulan fotos de pasaportes y cruzan fronteras

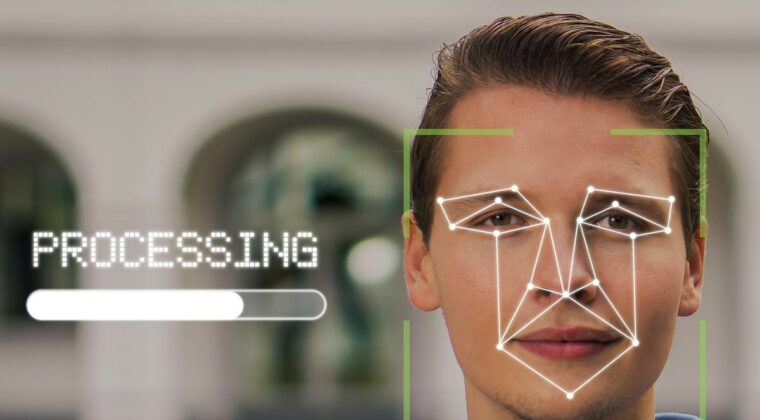

Los controles de fronteras han detectado recientemente una amenaza denominada 'morphing', caracterizada por la manipulación informática de las fotografías de pasaportes y documentos de identidad con el fin de falsificar estos documentos y burlar los sistemas biométricos faciales de seguridad.

Fuente: EP

Las denominadas ‘fronteras inteligentes’ llevan implantadas en España desde 2018, tal y como recuerdan desde el proveedor de soluciones de identificación, trazabilidad y autenticación SICPA en un comunicado de prensa remitido a Europa Press.

El primer sistema biométrico fue instalado aquel año en diversos controles situados en distintos puntos del país, como puertos, aeropuertos e, incluso, carreteras.

Este procedimiento de identificación integra una serie de factores, que van desde el registro facial y dactilar hasta el escaneo del pasaporte y las consultas en las bases de datos policiales nacionales e internacionales.

Dicho avance tecnológico ha dado pie al desarrollo de técnicas destinadas a la falsificación de perfiles personales. Entre ellas, el denominado ‘morphing’, método informático empleado por las mafias para cralizar una transición entre dos imágenes diferentes, suplantar identidades y superar los controles biométricos.

Esta tecnología se ha visto acompañada de la pandemia, que “ha propiciado un crecimiento de las empresas que adoptaron el registro ‘online’ al estar las oficinas cerradas, creando un entorno más susceptible para este tipo de ataque”, ha comentado el director de Autenticación de de WatchGuard Technologies, Alex Cagnoni, en declaraciones recogidas por Europa Press.

Gracias al ‘morphing’, los criminales pueden viajar libremente por fronteras y aduanas, además de liberar ‘smartphones’ y entrar en páginas web que contengan datos confidenciales de sus víctimas.

Por su parte, el investigador de amenazas y responsable del equipo de investigación Trend Micro Iberia, David Sancho, ha revelado que ya se han detectado intentos de entrada a fronteras europeas con pasaportes manipulados mediante ‘morphing’.

CÓMO SE LLEVA A CABO EL PROCESO DE ‘MORPHING’

Las técnicas empleadas para llevar a cabo el proceso del ‘morphing’ se apoyan en la Inteligencia Artificial (IA) de una forma similar a los ‘deepfakes’, que utilizan esta tecnología para crear contenido falso, según Sancho.

El procedimiento consiste en “interpolar imágenes para formar un espectro en el que cada una de las dos fotografías de partida están a los extremos”, ha señalado.

Para crear ese espectro de imágenes intermedias, se utiliza una serie de algoritmos que distorsionan la imagen píxel a píxel, con el objetivo de que se vaya pareciendo a la imagen final.

Esto se vuelve a realizar hasta que, tras una serie de iteraciones, la transición se completa y se obtiene la imagen final, aparentemente original y no modificada.

El algoritmo más utilizado para llevar a cabo transiciones con dos imágenes distintas es el Beier-Neely, que le debe su nombre a sus dos creadores, Thad Beier y Shawn Neely.

Tras llevar a cabo este proceso, se generará entre el modelo original y el modificado una imagen que “es mitad de una y mitad de la otra” y, por tanto, debe parecerse “a las dos fotografías originales”, según el responsable del equipo de investigación Trend Micro Iberia.

Para saber exactamente con cuál quedarse de ese espectro de fotografías, el experto señala que existen diferentes programas de ‘software’ que automatizan dicho proceso, como Adobe After Effects, además de sitios web como MorphThing.

CÓMO PROTEGERSE ANTE ESTA AMENAZA

Este investigador también ha asegurado que, en caso alguien pierda su pasaporte o alguien se lo robe, “lo normal es que su propietario lleve a cabo una denuncia e impida así la entrada a un país”.

Sin embargo, esta medida no sería suficiente y “no serviría de mucho si el documento se utiliza para otros propósitos, como crear identidades falsas con cuentas bancarias”, ha añadido Sancho.

A su vez, este investigador considera que el control digital en los puestos fronterizos es un aspecto que los distintos países han de tener en cuenta, además de validar visualmente la entrada y salida de personas en las fonteras.

“Es necesario hacerlo de manera electrónica, no a simple vista. Es un reto técnico que puede suponer un retraso en los puestos fronterizos”, ha argumentado.

Por su parte, Cagnoni ha aconsejado a las víctimas que se aseguren “de que proporcionan fotos actualizadas para cualquier documento nuevo” con el objetivo de evitar ser víctimas del ‘morphing’.

Además, ha recomendado tanto a las empresas, como a los gobiernos y controles fronterizos “tomar buenas medidas para la comprobación de la identidad, como un análisis más exhaustivo del rostro en directo o un análisis más preciso de las geometrías faciales”.

En este sentido, también ve necesario implementar la autenticación de dos factores. Por un lado, la biometría facial y, por otro, un mensaje de confirmación enviado al teléfono móvil del usuario. “Si un factor se ve comprometido, todavía hay otro por comprobar”, ha asegurado.

NUEVOS FORMATOS DE PROTECCIÓN

Para reforzar la seguridad e integridad de los ciudadanos los expertos de SICPA han desarrollado un sistema que toma la fotografía original de un documento de identidad (DNI, pasaporte o cédula) y la convierte en un ‘visual hash’.

Este código encriptado de 20 bytes integra una serie de algoritmos criptográficos que se incrustan en un código código QR securizado.

Este procedimiento es capaz de impedir las falsificaciones posteriores al tratarse de un proceso unidireccional, ya que el QR no puede emprender el camino inverso y convertirse en la fotografía original.

Esta firma especializada en soluciones de seguridad ha destacado que su procedimiento también facilita el intercambio de información entre países debido al tamaño del ‘visual hash’.

Asimismo, ha asegurado que gracias a este método se pueden agilizar los procesos de verificación biométrica en los controles fronterizos de los distintos estados.

China presenta un generador de vídeos con IA para competir con Sora

China presentó el sábado Vidu, un equivalente a la herramienta estadounidense de inteligencia artificial Sora, capaz de crear vídeos realistas con solo introducir un texto.

Sora, que se presentó en Estados Unidos en febrero, es propiedad de OpenAI, la compañía que desarrolló ChatGPT y el generador de imágenes DALL-E.

El lanzamiento de esta nueva herramienta es un gran avance en el campo de la IA y fue muy seguido en China.

Shengshu, una empresa fundada el año pasado en Pekín, anuncio el sábado la creación de Vidu que según la compañía puede crear vídeos realistas de 16 segundos en alta definición a partir de texto.

“Desde el lanzamiento de Sora, Vidu es el primer modelo de vídeo de estas prestaciones en el mundo”, dijo Shengshu.

La AFP no ha podido verificar de forma independiente estas afirmaciones.

La compañía publicó un vídeo con imágenes muy realistas creadas mediante inteligencia artificial.

Según su página web, el equipo de Shengshu incluye ingenieros de los gigantes digitales chinos ByteDance (propietario de TikTok), Tencent, Baidu y Alibaba, así como de la prestigiosa universidad Tsinghua.

© Agence France-Presse

Truco de WhatsApp para transferir fotos, videos y documentos desde el celular al computador sin cables

Esta opción también ofrece una capa adicional de seguridad, debido a que toda la información se transfiere a través de una conexión cifrada

Hace un buen tiempo se acabó la época en la que era necesario utilizar cables o depender de la sincronización de los sistemas para transferir archivos de un celular a un computador. De hecho, aunque muchos usuarios no lo saben, realizar esta tarea es mucho más sencillo gracias a un truco de WhatsApp que solo requiere unos cuantos pasos para ser activado.

Recordemos que plataforma de mensajería instantánea propiedad de Meta, que cuenta con más de 2.000 millones de usuarios a nivel global, cuenta con el ‘Modo Multidispositivo’, que es la opción que deja acceder a las diferentes versiones de este servicio, además de la del móvil, como por ejemplo: WhatsApp Web (navegadores), WhatsApp para Windows y MacOS (programa en computadoras), así como la app nativa para tabletas Android y relojes inteligentes.

Para aplicar el secreto que simplifica la transferencia de contenidos desde dispositivos móviles a ordenadores, se requiere utilizar el formato de la aplicación diseñado para ser utilizado desde cualquier tipo de navegador.

Cómo utilizar el truco de WhatsApp para la transferencia de archivos

Para utilizar WhatsApp con el objetivo de compartir fácilmente archivos multimedia, como fotos y videos, de un teléfono a un PC, se requiere:

- Ingresar a WhatsApp Web.

- Escanear el código QR mostrado en la pantalla del ordenador con el celular.

- Tras completar esta autenticación, se establece una conexión segura entre el teléfono y el computador, permitiendo la transferencia de archivos.

- Crear un chat nuevo con el usuario propietario de la cuenta como destinatario.

- Adjuntar y enviar los archivos multimedia que se desean transferir desde tu teléfono.

- Una vez los archivos estén disponibles en la versión web, se podrán descargar directamente al ordenador. Se recomienda utilizar la opción de conservar la calidad original seleccionando “HD” antes del envío.

- Pulsar sobre el icono de descarga en la parte superior derecha de la pantalla para guardarlos en el ordenador.

La transferencia de archivos sin cables es una de las tantas características que mantienen a WhatsApp como una de las aplicaciones de mensajería instantánea más populares y utilizadas a nivel mundial. Con actualizaciones constantes para mejorar y añadir nuevas funcionalidades, la plataforma busca ofrecer la mejor experiencia posible a sus usuarios.

Qué son los nuevos filtros de chat en WhatsApp

WhatsApp recientemente incorporó los nuevos filtros de chat en su plataforma, una mejora diseñada para permitir a los usuarios localizar conversaciones de manera más rápida y sencilla.

Según se explicó en un comunicado oficial de la compañía, esta funcionalidad ya ha comenzado a desplegarse entre algunos usuarios y se espera que esté disponible de manera general en las próximas semanas.

La actualización surge como respuesta a la necesidad de gestionar de manera más eficiente los mensajes dentro de la aplicación, dado el uso cada vez más amplio que las personas hacen de WhatsApp para diferentes propósitos.

En este caso, la herramienta ofrece tres opciones de filtrado, las cuales son:

- Todos: la vista predeterminada de todos tus mensajes.

- No leídos: la opción perfecta para cuando quieres ver con qué conversaciones necesitas ponerte al día o cuáles debes responder. Muestra mensajes que están marcados por ti como no leídos o que aún no abriste, por lo que puedes dar prioridad a tus respuestas.

- Grupos: una función muy solicitada. Ahora todos tus chats en grupo se organizarán en un solo lugar, por lo que será más fácil encontrar tus favoritos, ya sea tu cena familiar semanal o la planificación de tus próximas vacaciones. Aquí también se incluirán subgrupos de comunidades.

Los filtros están ubicados en la parte superior de los chats y hay que tocarlos o hacer clic en ellos para aplicarlos. También es posible deslizar la pantalla hacia la izquierda o la derecha para cambiar las vistas de los filtros.

Apple elimina WhatsApp y otras ‘apps’ populares de su tienda en China

“Estamos obligados a seguir las leyes de los países donde operamos, incluso cuando no estamos de acuerdo”, comunicó un portavoz de la compañía.

La compañía estadounidense Apple tuvo que eliminar WhatsApp y Threads —ambas redes sociales pertenecientes a Meta*— de su tienda App Store en China a petición de las autoridades locales, informó The Wall Street Journal este viernes.

Telegram y Signal, otras dos plataformas de mensajería extranjeras, también fueron retiradas de la App Store china este viernes. De acuerdo con Apple, la Administración del Ciberespacio de China le ordenó eliminar ciertas aplicaciones por motivos de seguridad nacional.

Un portavoz de Apple declaró: “Estamos obligados a seguir las leyes de los países donde operamos, incluso cuando no estamos de acuerdo”.

Durante la última década, Instagram, X, Facebook, YouTube y WhatsApp fueron descargadas de la tienda de aplicaciones de Apple más de 170 millones de veces en su conjunto en el territorio del gigante asiático, según estimaciones de la firma de inteligencia de mercado Sensor Tower.

No obstante, el Gobierno chino dictaminó el año pasado que los desarrolladores de aplicaciones móviles debían registrar sus aplicaciones ante los reguladores nacionales antes de marzo de 2024, de lo contrario serían eliminadas de las tiendas de ‘apps’. En este contexto, el personal de Apple se reunió con las autoridades chinas para expresar su preocupación sobre la implementación de la normativa. “En ese momento los funcionarios le dijeron a Apple que tenía que implementar estrictamente las reglas”, concluye el medio.

:quality(99)/cloudfront-us-east-1.images.arcpublishing.com/lanacionpy/T72DPGFVAZALHADVS3QOMG3EE4.jpg)

:quality(99)/cloudfront-us-east-1.images.arcpublishing.com/lanacionpy/FEBECJQXYFEW3HDGOJK5NXPKHI.jpg)

:quality(99)/cloudfront-us-east-1.images.arcpublishing.com/lanacionpy/A2BYSACDBVAI5ER6NY5HAAVXYM.jpg)

:quality(99)/cloudfront-us-east-1.images.arcpublishing.com/lanacionpy/23MHZ66INVHILJVSMGX2HXUJ7Q.jpg)

:quality(99)/cloudfront-us-east-1.images.arcpublishing.com/lanacionpy/DE5WFAQOCRGAHBMA552KPGR72I.jpg)

:quality(99)/cloudfront-us-east-1.images.arcpublishing.com/lanacionpy/L4OSO77EFFHBDBRNIB6ABCOL5Q.jpg)